Vojáci USA zřejmě použili ve Venezuele AI model Claude. Koubský: Od firmy Anthropic je to pokrytecké

Americká armáda použila AI model Claude firmy Anthropic při své vojenské operaci ve Venezuele, kdy zadržela tamního prezidenta Nicoláse Madura, napsal s odvoláním na nejmenované zdroje americký deník Wall Street Journal. K čemu konkrétně měla armáda umělou inteligenci použít, deník neuvedl. „Anthropic se snaží uplatňovat jakási vyšší morální měřítka. Ale vidíme, že je to s měřítky těžké,“ poukazuje v pořadu Online Plus vědecký redaktor Deníku N Petr Koubský.

Vojáci měli AI model použít prostřednictvím služeb firmy Palantir Technologies, která firmám i armádě dodává nástroje k analýze dat.

Firma Anthropic loni uzavřela s americkým ministerstvem obrany smlouvu, ve které za 200 milionů dolarů dává vojákům model Claude k dispozici v rámci obranných operací. Podle Wall Street Journalu ale spolupráce záhy přerostla ve spor o to, kde jsou hranice nasazení AI.

Čtěte také

Anthropic totiž odmítá využívání modelu k vývoji zbraňových systémů, ke sledování občanů vlastního státu či v rámci autonomně fungujících zbraní.

Ministerstvo teď firmě hrozí tím, že pokud ze svých omezení nesleví, zařadí Anthropic na seznam rizikových dodavatelů, což by výrazně omezilo možnosti nasazení modelu Claude ve státních úřadech.

V článku není uvedeno, k čemu konkrétně byl Claude v rámci vojenské operace využit. Nicméně to, že Anthropic uzavřel smlouvu s americkou armádou, potažmo ministerstvem obrany, a o tom, že jeho model se bude používat při vojenských operacích, se informovalo již dříve. Také spor o to, kde jsou hranice používání AI v armádě, je veřejný.

Kde je hranice?

Případ, který popisuje Wall Street Journal, není první svého druhu.

Čtěte také

„Těch případů je hodně a bude hodně i takových, které neznáme. Umělá inteligence v širším smyslu slova je velice intenzivně nasazovaná přímo v bojových operacích v ruské válce na Ukrajině na obou stranách konfliktu a myslím, že všechny velké, technologicky vyspělé armády světa – americká, izraelská, ukrajinská, ruská, armády evropských států – nějakým způsobem pracují s využitím umělé inteligence pro obranné i útočné účely,“ ujišťuje novinář Petr Koubský.

„V poslední době jsem několikrát slyšel o společnosti Anthropic. Prý si trochu neprávem snaží dělat dobré jméno na tom, že se tváří, jako by na etiku použití umělé inteligence kladla větší důraz než jiní, přitom to ale nedělá,“ pokračuje Koubský s tím, že si není jistý, zda je o spravedlivé obvinění.

Čtěte také

„Řekl bych, že Anthropic se snaží od ostatních firem odlišit nejen na oko, ale i reálně tím, že uplatňuje jakási vyšší morální měřítka. Ale na tomto příkladu vidíme, že je to s měřítky těžké,“ doplňuje a přiznává:

„Dát technologii k dispozici vojákům s tím, že se může používat jen pro obranné operace, to nevím, jestli už se nedá označit jako pokrytectví. Kde je hranice mezi obranou a útočnou operací, je velice často záležitost zpětné interpretace výkladů. Nevím, co si o tomhle případu myslet.“

Etika AI

Případ vyvolává otázky o etické hranici používání AI k vojenským účelům. AI výzkumníci v již minulosti varovali před použitím umělé inteligence ve zbraňových systémech nebo před tím, že by umělá inteligence mohla jednou rozhodovat, na jaký cíl zaútočí. Jak určit, do jaké míry by se AI ještě mohla v armádních aplikacích používat a kde už by to přijatelné být nemělo?

Čtěte také

„Velice přibližný konsenzus – nikoli na úrovni dohody, ale na úrovni úvah nebo nějakého většinového uvažování – je nad tím, že hlavním měřítkem je dosud něco, čemu se říká man in the loop, tedy člověk uvnitř smyčky. Jinými slovy, aby systémy umělé inteligence neměly úplnou autonomii v těchto nasazeních, ale aby tam vždy byla nějaká kontrola člověkem, který nakonec rozhodne o tom, co se udělá a neudělá,“ popisuje Koubský minimální etický požadavek pro vojenské aplikace umělé inteligence.

Otázkou podle něj je, do jaké míry se toto etické minimum využívá a bude využívat, jakmile rozhoduje vojenská efektivita a nikoli etické ohledy. Historické využití technologií pro vojenské účely je podle Koubského instruktivní.

Čtěte také

„Většinou to probíhalo tak, že když se objevila nějaká drtivá technologická inovace – třeba bojové plyny v první světové válce – tak se etika velice rychle odhodila na obou stranách a začaly to používat obě,“ hledá novinář historickou paralelu a rozvíjí ji:

„Po nějaké době si obě strany uvědomily, jak je to pustošivé a ničivé a že se tím stejně nedá získat žádná zásadní vojenská výhoda, protože každý krok je vyvážen protikrokem té druhé strany. Teprve potom se začaly zvažovat dohody o tom, že se to nebude používat.“

A občas se i dodržely, dodává Koubský: „To je příklad chemických zbraní, bakteriologických zbraní nebo jaderných zbraní, které nebyly s výjimkou prvního nasazení na konci druhé světové války nikdy bojově použity a doufejme, že to tak zůstane.“

„Třeba to podobně bude i s umělou inteligencí. Ale ve všech případech v minulosti to bylo vynuceno strachem z toho, kam použití těchto zbraní by mohlo vést pro obě zúčastněné strany a vědomím toho, že nelze získat s jejich pomocí žádnou vojenskou výhodu. Pokud tohle nebude splněno, tak nedojde ani k žádnému omezení nebo dohodě,“ uzavírá vědecký novinář.

Může být americký soud o návykovosti sociálních sítí přelomový? Co vedlo Google k tomu, aby v rámci AI chatbotu Gemini zavedl generování hudby? A může být návykové i online nakupování? Poslechněte si celé Online Plus.

Mohlo by vás zajímat

Nejposlouchanější

Více z pořadu

E-shop Českého rozhlasu

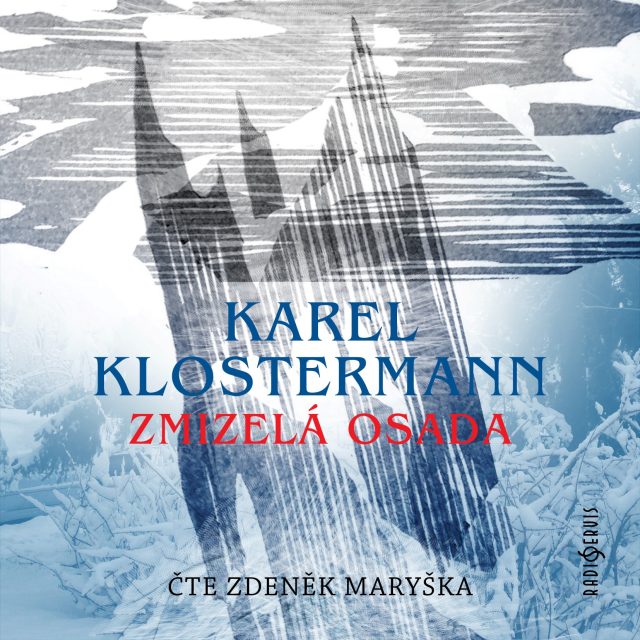

Starosvětské příběhy lesníků z časů, kdy se na Šumavě ještě žilo podle staletých tradic.

Václav Žmolík, moderátor

Zmizelá osada

Dramatický příběh viny a trestu odehrávající se v hlubokých lesích nenávratně zmizelé staré Šumavy, několik let po ničivém polomu z roku 1870.